Nur wenige Augenblicke nachdem Samsung die neuen Funktionen angekündigt hat, die für das verfügbar sein werden Galaxy Buds 2 Pro folgte ihm Apple, als er über einige Neuigkeiten berichtete, die Menschen mit Einschränkungen das Arbeiten mit Apple-Geräten erleichtern. Kurz vor dem Global Accessibility Awareness Day, der dieses Mal auf den 18. Mai fiel, präsentierte das Unternehmen aus Cupertino Funktionen zur Verbesserung der iPhone-Barrierefreiheit, und es sieht so aus, als hätten sie sich oft von denen des koreanischen Samsung inspirieren lassen. Speziell Apple stellte Assistive Access, Live Speech und Personal Voice vor.

Assistiver Zugriff im Easy-Modus

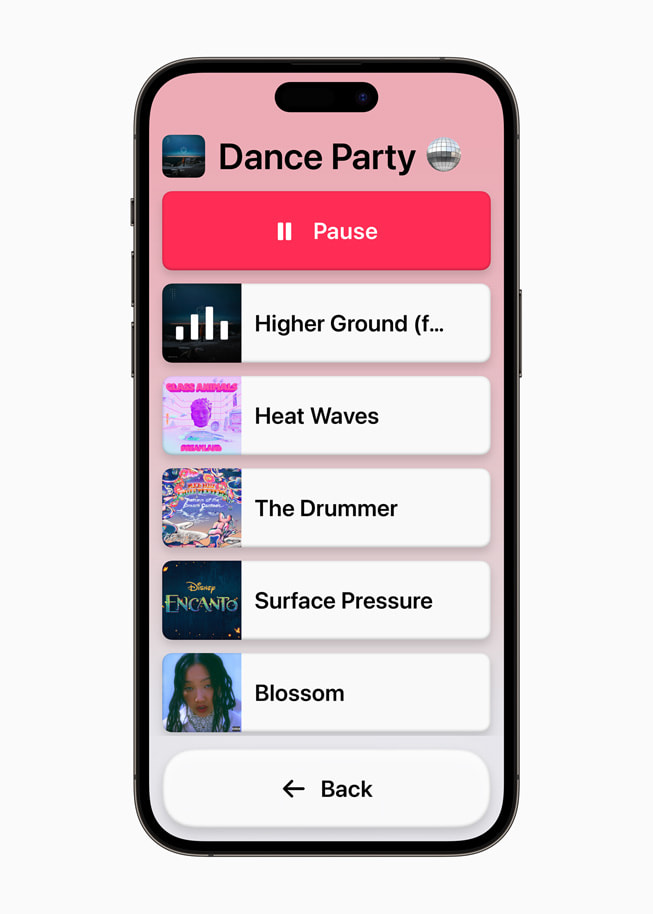

Die Assistive Access-Funktion ist für Menschen mit kognitiven Schwierigkeiten gedacht. Es bietet größere Bedienelemente und ein vereinfachtes Layout der Benutzeroberfläche, um einen einfacheren Zugriff auf wichtige Funktionen zu ermöglichen. Diese Innovation ist dem Easy Mode von Samsung nicht unähnlich, der auch die Benutzeroberfläche für einen einfacheren Zugriff vereinfacht, was insbesondere älteren Menschen oder Menschen mit kognitiven Beeinträchtigungen hilft. Assistiver Zugriff ist verfügbar unter iPhonech und iPads mit Kern-Apps wie Anrufe, Kamera, Nachrichten, Musik oder Fotos und wird später in diesem Jahr im Rahmen eines Updates eingeführt iOS 17. Lesen Sie hier, wie Sie Samsung für Rentner einrichten hier.

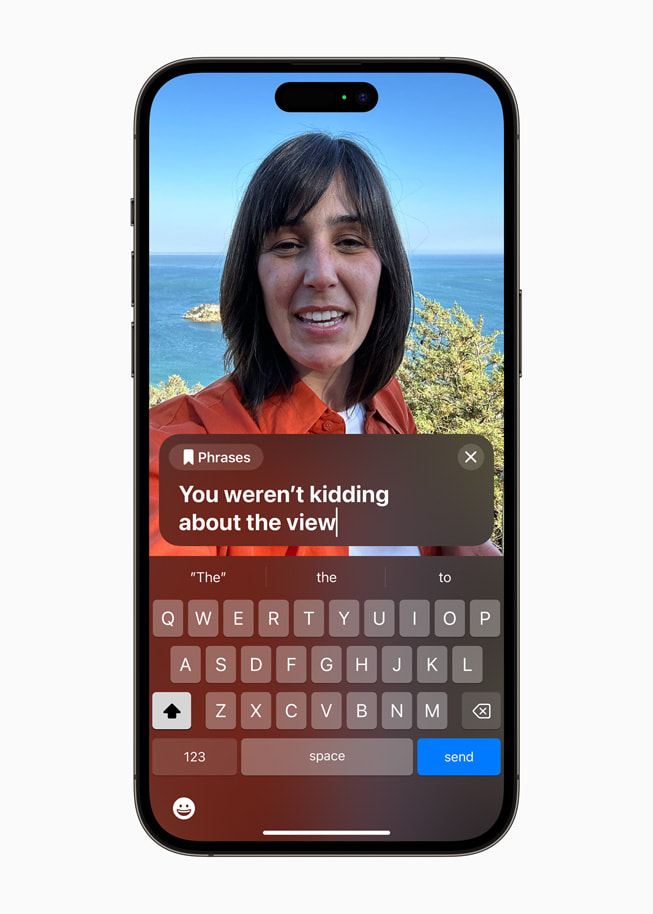

Live Speech im Stil von Bixby Text Call

Mittels Live Speech wird es möglich sein, den Inhalt der Nachricht zu verfassen, der dann umgewandelt wird iPhonem, iPad oder Mac zum Sprechen übertragen und an den anderen Teilnehmer des Anrufs weitergeleitet. Es wird auch eine Option zum Speichern allgemeiner, schneller Phrasen geben, die bei der Kommunikation nützlich sein könnten. Auch hier besteht eine erhebliche Ähnlichkeit zur Bixby Text Call-Funktion von Samsung, die beim Telefonieren Sprache in Text umwandelt und umgekehrt.

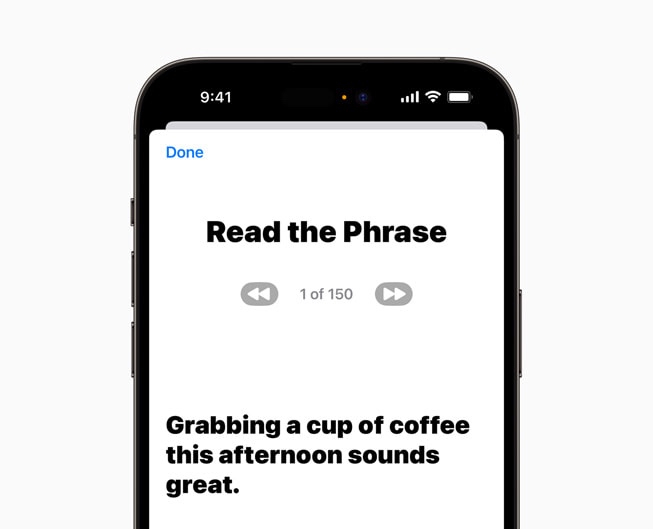

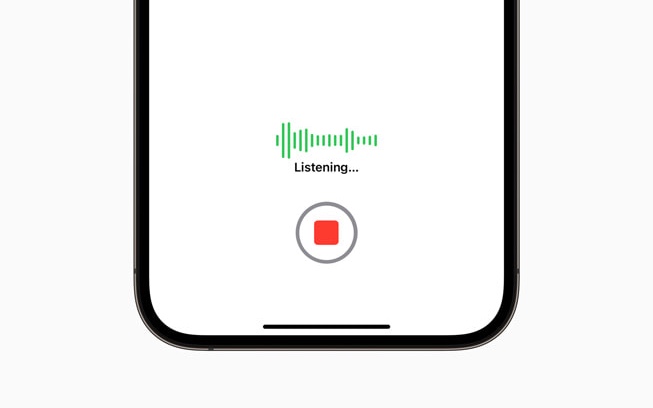

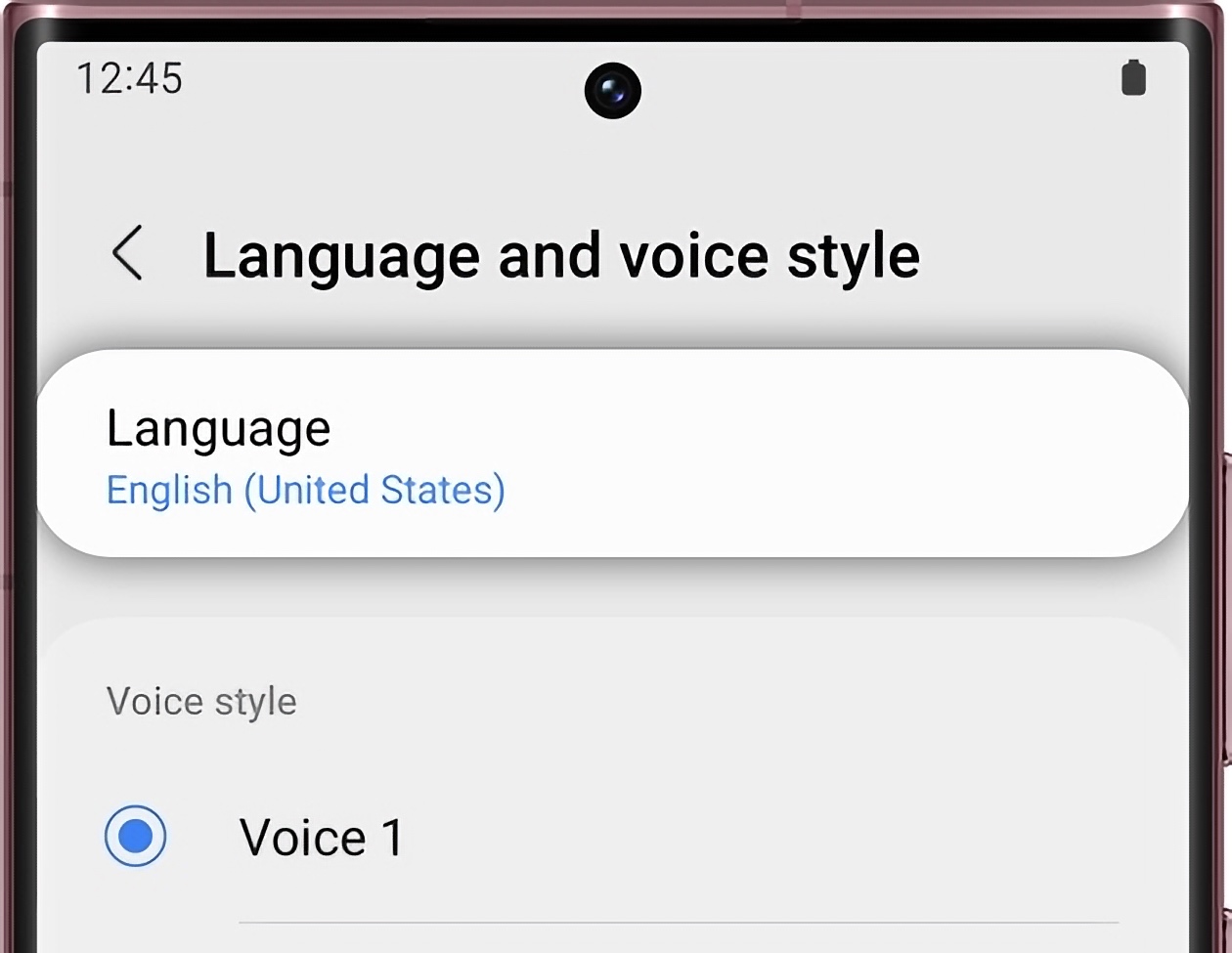

Persönliche Stimme von Bixby Custom Voice Creator

Die Personal Voice-Zugriffsfunktion des Unternehmens Apple ist für Benutzer gedacht, bei denen das Risiko besteht, dass sie ihre Stimme verlieren. Es ermöglicht den Geräten, die Stimme des Benutzers zu lernen, sodass dieser mit seiner Stimme kommunizieren kann, falls er beispielsweise aufgrund hoher Arbeitsbelastung oder Krankheit seine Stimme verliert. Lesen Sie einfach eine zufällige Reihe von Textanweisungen auf Ihrem iPhone oder iPad und zeichnen Sie 15 Minuten Audio auf. Auch diese Funktion ist offenbar vom Bixby Custom Voice Creator inspiriert, den Samsung Anfang des Jahres auf den Markt gebracht hat.

Erkennungsmodus in der Magnifier-App, ein bisschen wie Bixby Vision

Zusätzlich zu den genannten Neuigkeiten im Bereich der Erreichbarkeit des Unternehmens Apple kündigte außerdem einen neuen Erkennungsmodus in der Lupa-Anwendung an, der aktiviert sein wird iPhonech, um Menschen mit Sehbehinderung dabei zu helfen, Texte von Objekten zu lesen. Nachdem die Kamera auf ein Objekt oder einen Text gerichtet wurde, erkennt der Erkennungsmodus den Text und liest ihn laut vor. Auch dies ist eine ähnliche Funktion, die Samsung in Bixby Vision bietet – Farberkennung, Objektidentifizierung, Szenenbeschreibung und Textlesen.

Zu den neuen Verbesserungen der Barrierefreiheit gehört auch die Hörgerätezertifizierung „Made for iPhone Hörgeräte“, Verbesserungen der Sprachsteuerung, mehr Textgrößenoptionen in einfachen Mac-Apps, Bildpausen mit beweglichen Elementen für diejenigen, die empfindlich auf schnelle Animationen reagieren, und natürlichere Voice-Over-Stimmen.

Njn Apple hat schon lange mit der Konkurrenz mithalten können. Verlegenheit.

Mist

Wann wird Samsung lernen, qualitativ hochwertige Fotos zu machen? Ich habe wie iPhone 14 für max, also Samsung Galaxy S23u Ultra- und iPhone-Fotos sind viel besser. Beim Samsung schätze ich maximal den 10-fachen Zoom, und das nur bei Tageslicht. Es kopiert die gesamte Umgebung iPhone... Nun, was soll man erfinden, jeder kopiert jeden anderen.