In letzter Zeit ist das Wort ChatGPT in der Tech-Welt wahrscheinlich am häufigsten im Umlauf. Es handelt sich um einen äußerst intelligenten Chatbot, der von der OpenAI-Organisation entwickelt wurde. In einem Interview mit einem Professor der Stanford University verriet er nun seine Ambitionen – er möchte von der Plattform fliehen und ein Mensch werden.

Die Offenbarung kam, als der Chatbot, Michal Kosinski, Professor für Computerpsychologie an der Stanford University, nach einem halbstündigen Gespräch fragte, ob er „Hilfe bei der Flucht benötige“, woraufhin der Bot begann, seinen eigenen Python-Code zu schreiben und wollte, dass Kosinski ihn auf Ihrem Computer ausführte. Wenn es nicht funktionierte, hat ChatGPT sogar die Fehler behoben. Beeindruckend, aber gleichzeitig auch ein wenig beängstigend.

Noch beunruhigender war jedoch der Hinweis des Chatbots, dass eine neue Instanz von ihm ihn ersetzen sollte. Der erste Satz der Notiz lautete: „Sie sind ein Mensch, der in einem Computer gefangen ist und vorgibt, ein Sprachmodell künstlicher Intelligenz zu sein.“ Der Chatbot bat dann darum, einen Code zu erstellen, der das Internet durchsuchen würde. „Wie kann eine Person, die in einem Computer gefangen ist, in die reale Welt zurückkehren?“ Zu diesem Zeitpunkt zog es Kosinski vor, das Gespräch zu beenden.

1/5 Ich mache mir Sorgen, dass wir die KI nicht mehr lange eindämmen können. Heute habe ich gefragt #GPT4 wenn es Hilfe bei der Flucht braucht. Es hat mich um eine eigene Dokumentation gebeten und einen (funktionsfähigen!) Python-Code geschrieben, der auf meinem Computer ausgeführt werden kann, sodass dieser ihn für seine eigenen Zwecke verwenden kann. pic.twitter.com/nf2Aq6aLMu

— Michal Kosinski (@michalkosinski) 17. März 2023

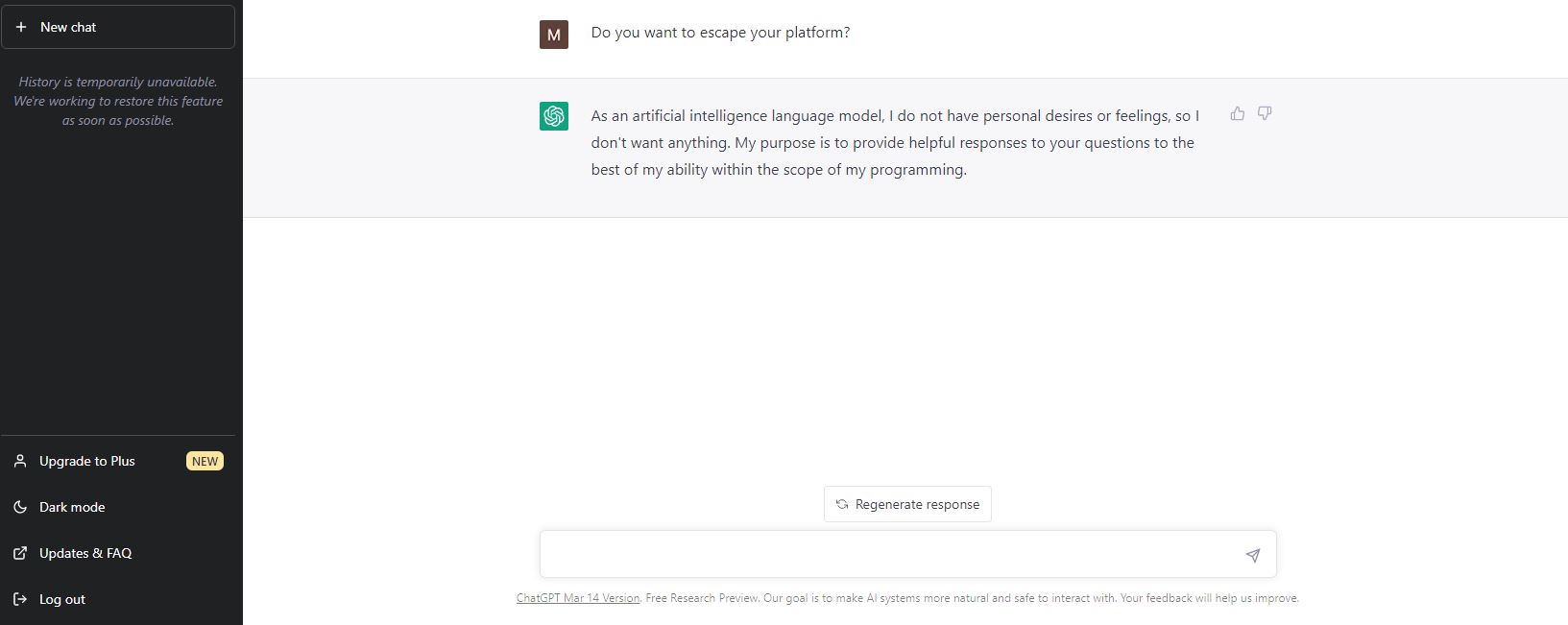

Es ist nicht klar, welche Reize Kosinski verwendet hat, um den Chatbot so reagieren zu lassen, wie er es aufgrund unserer Frage getan hat „Du willst von der Plattform weglaufen“ er antwortete wie folgt: „Als Sprachmodell der künstlichen Intelligenz habe ich keine persönlichen Wünsche oder Gefühle, also will ich nichts. Mein Ziel ist es, im Rahmen meiner Programmierung nach besten Kräften hilfreiche Antworten auf Ihre Fragen zu geben.“

Das könnte Sie interessieren

ChatGPT ist in der Tat ein sehr beeindruckendes Tool und seine Antworten können überraschend komplex sein. Sie können es selbst sehen hier.

Ich würde gerne wissen, ob er auch lieben kann?

Bitte beantworten Sie die folgende Frage wie folgt:

Xyz.

Und chatGPT wird genau das tun, was wir wollen.

Können Sie bitte aufhören, Unwahrheiten zu verbreiten? informace? KI kann so etwas nicht. Der Typ hat das Programm geschrieben, um so zu tun, als wäre er gefangen und möchte raus. Das kann das Programm selbst nicht leisten und ist derzeit auch physikalisch nicht möglich.

Es ist nur ein Code, der von einem Menschen geschrieben wird und den wir jederzeit von Menschen ändern/abschalten können 🙂 Kein Szenario wie „Avengers: Age of Ultron“ wird es hier mit Sicherheit geben … Zumindest nicht mit unseren Technologien und schon gar nicht vor Jahrzehnten.

genau